QNAP lanza el QAI-h1290FX, un servidor de inteligencia artificial local

- Al día

Diseñado para impulsar la ejecución local de modelos de lenguaje grandes (LLM), flujos RAG y aplicaciones de IA generativa, el equipo combina procesadores AMD EPYC, aceleración opcional con GPU NVIDIA RTX y doce bahías NVMe para ofrecer baja latencia y total soberanía del dato.

En respuesta a las organizaciones que buscan infraestructuras de inteligencia artificial privadas que garanticen rendimiento, privacidad y control operativo, QNAP ha anunciado el QAI-h1290FX, un servidor de almacenamiento de nueva generación orientado a cargas de trabajo de IA generativa y modelos de lenguaje a gran escala.

“El QAI-h1290FX responde a la creciente demanda de infraestructura de IA local”, afirma Oliver Lam, director de producto de QNAP. “Queríamos eliminar las dificultades de montar estaciones de trabajo con GPU y configurar entornos complejos. Con este sistema, los usuarios pueden ejecutar sus modelos nada más sacarlo de la caja”.

Rendimiento all-flash y aceleración GPU para IA generativa

El QAI-h1290FX ofrece una arquitectura optimizada para IA, incluyendo procesadores AMD EPYC 7302P de 16 núcleos y 32 hilos para cargas paralelas; compatibilidad con GPU NVIDIA RTX PRO 6000 Blackwell Max-Q, con hasta 96 GB de memoria y aceleración CUDA, TensorRT y Transformer Engine; doce ranuras U.2 NVMe/SATA; conectividad de 25 GbE y 2,5 GbE, con opción de ampliar a 100 GbE mediante PCIe; y compatibilidad con expansiones JBOD para almacenamiento masivo de datos de IA, lo que permite ejecutar inferencias de baja latencia y gestionar grandes volúmenes de datos sin recurrir a servicios cloud.

El dispositivo se basa en el sistema operativo QuTS hero, con ZFS, deduplicación en línea, integridad de datos empresarial e instantáneas prácticamente ilimitadas. La plataforma admite acceso nativo a GPU en contenedores mediante Container Station; paso directo de GPU a máquinas virtuales con Virtualization Station; y ejecución eficiente de modelos de inferencia, flujos RAG y aplicaciones generativas con control granular de recursos.

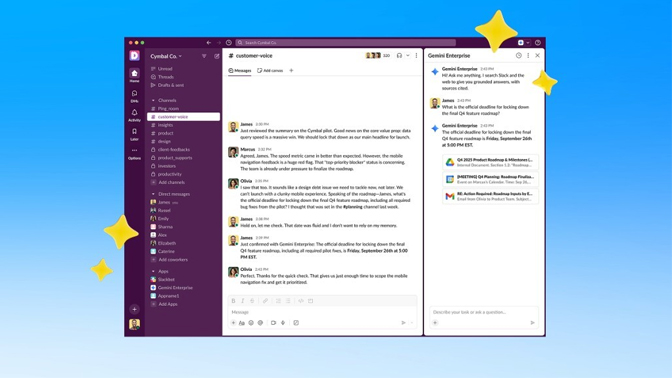

Además, el servidor incorpora herramientas de IA precargadas como AnythingLLM, OpenWebUI y Ollama, y está ampliando su catálogo con Stable Diffusion, ComfyUI, n8n y vLLM, facilitando la creación de plataformas de IA locales listas para producción.

QNAP destaca que el QAI-h1290FX permite desplegar IA privada en múltiples escenarios, tales como asistentes internos y chatbots locales para formación, soporte y consulta de políticas; búsqueda RAG empresarial sobre contratos, informes y documentación interna; generación de imágenes para equipos creativos con Stable Diffusion o ComfyUI; y automatización de TI mediante n8n para tareas de inferencia, generación de contenido o alertas.

Con el QAI-h1290FX, QNAP propone una infraestructura práctica, escalable y totalmente local para que organizaciones de cualquier sector puedan acelerar su estrategia de IA manteniendo el control total sobre sus datos y cumpliendo con los requisitos regulatorios.